Определение эмоционального состояния человека с помощью компьютерного анализа параметров звуковой волны (Александр Шкарапута, SECR-2019) — различия между версиями

Материал из 0x1.tv

StasFomin (обсуждение | вклад) |

StasFomin (обсуждение | вклад) |

||

{{LinksSection}}

* [https://2019.secrus.org/program/submitted-presentations/determining-the-emotional-state-of-a-person-using-computer-analysis-of-sound-wave-parameters/ Talks page on SECR site]

<!-- <blockquote>[©]</blockquote> -->

<references/>

<!-- topub -->

{{stats|disqus_comments=0|refresh_time=2020-01-08T17:49:10.962352|youtube_plays=0}}

[[Категория:SECR-2019]]

[[Категория:Алгоритмы]]

[[Категория:Психология пользователя]]

[[Категория:NeedFix]] | |||

Версия 11:05, 15 января 2020

- Докладчик

- Александр Шкарапута

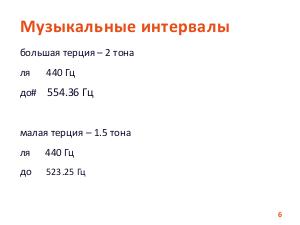

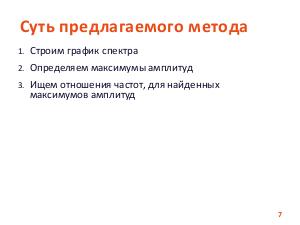

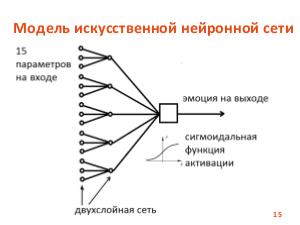

Нашей исследовательской группой разработана методика, позволяющая определить эмоциональное состояние человека по голосу. Основная ее идея состоит в том, что для распознавания используются характеристики, связанные с музыкальными интервалами.

На предложенный способ распознавания не влияют факторы, сказывающиеся на эффективности других методов (вибрато, придыхания, язык диктора…). Метод не требует большой выборки для обучения и упрощает создание программных приложений, определяющих эмоциональное состояние по голосу.

Видео

Посмотрели доклад? Понравился? Напишите комментарий! Не согласны? Тем более напишите.

Презентация

Примечания и ссылки

Plays:0

Comments:0