Проектирование интерфейса голосового помощника (Нелли Кам, ProfsoUX-2018) — различия между версиями

Материал из 0x1.tv

StasFomin (обсуждение | вклад) (Новая страница: «;{{SpeakerInfo}}: {{Speaker|Нелли Кам}} <blockquote> Доклад рассчитан на дизайнеров, которым предстоит прое…») |

StasFomin (обсуждение | вклад) (Batch edit: replace PCRE (\n\n)+(\n) with \2) |

||

| (не показано 30 промежуточных версий этого же участника) | |||

# Модели реализации. Способы анимации. Неочевидные и иногда необходимые состояния на примере нашего приложения.

# Как наша нейросеть обрабатывает голосовой поток (кратко о разработке).

# Лифтёры: один из идеальных кейсов использования.

# Проблемы и ошибки: браузеры, технологии, психология (подростки и пример Калифорнии), как мы развернулись на 360 градусов за год, опасность визуализации «красивых интерфейсов будущего»

# Внутренние инструменты: как выглядят ответы изнутри. И как работа дизайнера с консолью помогла нам ускорить разработку.

# Демонстрация и видео.

</blockquote>

{{VideoSection}}

{{vimeoembed|267044903|800|450}}

<!-- {{youtubelink|}} -->

|vOMOVRkw8lc}}{{letscomment}}

{{SlidesSection}}

[[File:Проектирование интерфейса голосового помощника (Нелли Кам, ProfsoUX-2018).pdf|left|page=-|300px]]

{{----}}

[[File:{{#setmainimage:Проектирование интерфейса голосового помощника (Нелли Кам, ProfsoUX-2018).jpg}}|center|640px]]

{{LinksSection}}

* Нелли Кам

* https://2018.profsoux.ru/papers/voice-interface-design

<!-- <blockquote>[©]</blockquote> -->

{{vklink|1118}}

{{fblink|2088613864724957}}

<references/>

<!-- topub -->

{{stats|disqus_comments=0|refresh_time=2021-08-31T18:06:38.247502|vimeo_plays=152|youtube_comments=0|youtube_plays=172}}

[[Категория:ProfsoUX-2018]]

[[Категория:Draft]] | |||

Текущая версия на 12:22, 4 сентября 2021

- Докладчик

- Нелли Кам

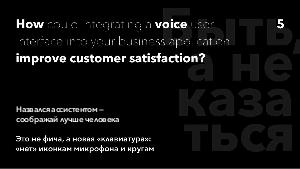

Доклад рассчитан на дизайнеров, которым предстоит проектировать голосовой интерфейс.

Многим из нас предстоит, так как подростки уже начинают говорить с телефонами. И не стесняются.

Больше года мы разрабатываем голосовой интерфейс для нашего приложения. Год назад голосом можно было создать событие, сделать поиск. Потом мы сделали аудио заметки, которые конвертируются в текст. Теперь вернулись обратно к голосовому управлению и встраиваемся в интерфейсы корпоративных приложений.

Сейчас мы в процессе разработки интерфейса, который позволит сотрудникам корпораций, взаимодействовать со всеми своими приложениями (календари, почта, CRM, формы отчетности и т. д.) без необходимости смотреть в телефон. Сири и Алекса не делают этого. У них есть информация о человеке и его приложениях, но нет доступа к рабочему пространству, они не умеют заполнять сложные рабочие формы. Мы — умеем.

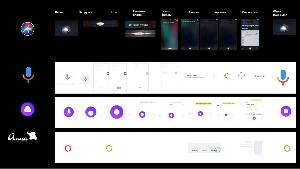

С первого взгляда, спроектировать голосовой интерфейс было легко. Есть много примеров: Сири, Алекса, Гугл, Алиса. Мы изучили основные состояния, которые они показывают. Обосновали, когда-какие помощники должны по разному себя вести, выглядеть и быть доступными. Сделали много ошибок и итераций. Хочу рассказать об этом опыте.

План доклада

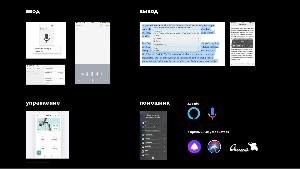

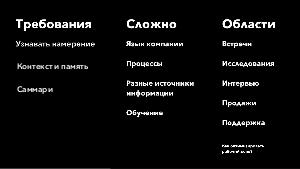

- Отличия голосового интерфейса, помощника, чтения экрана, диктовки. Контекст и состояния Сири, Алексы, Алисы, Анны (для браузера), Гуглдоков.

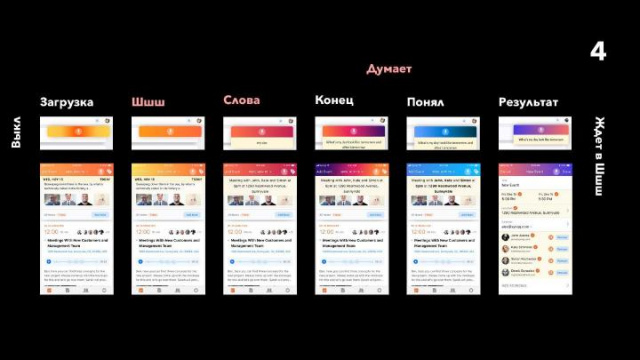

- Модели реализации. Способы анимации. Неочевидные и иногда необходимые состояния на примере нашего приложения.

- Как наша нейросеть обрабатывает голосовой поток (кратко о разработке).

- Лифтёры: один из идеальных кейсов использования.

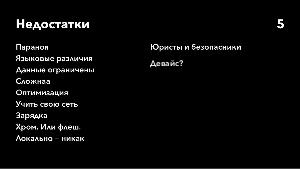

- Проблемы и ошибки: браузеры, технологии, психология (подростки и пример Калифорнии), как мы развернулись на 360 градусов за год, опасность визуализации «красивых интерфейсов будущего»

- Внутренние инструменты: как выглядят ответы изнутри. И как работа дизайнера с консолью помогла нам ускорить разработку.

- Демонстрация и видео.

Видео

Посмотрели доклад? Понравился? Напишите комментарий! Не согласны? Тем более напишите.

Презентация

Примечания и ссылки

Plays:324

Comments:0