Круглый стол «Безопасность операционных систем в контексте искусственного интеллекта» (OSDAY-2025)

Материал из 0x1.tv

- Ведущий

- Андрей Духвалов — вице-президент, директор департамента перспективных технологий, Лаборатория Касперского

- Эксперты

- Сергей Аносов — руководитель отдела продуктовой экспертизы «Открытая мобильная платформа»

- Егор Васин — специалист отдела технологий защиты вычислительных сетей НПП «Криптософт»

- Николай Костригин — руководитель отдела безопасности разработки ПО, «Базальт СПО»

- Михаил Новоселов — ведущий системный инженер-программист, НТЦ IT РОСА

- Екатерина Свиридова — «Газпромбанк», РЭУ им. Плеханова

- Егор Смирнов — руководитель проектов по внедрению искусственного интеллекта «Ред Софт»

- Константин Сорокин — руководитель исследовательской группы «ИИ в программной инженерии», ИСП РАН

- Павел Мозгов — заместитель директора дирекции внедрения и сопровождения, группа «Астра»

- Пересечение трендов

- ОС, ИИ и программирование. Выделили три взаимосвязанных технологических тренда: операционные системы (70 лет развития), искусственный интеллект (быстрый рост) и программирование (эволюция методологий). Ключевой вопрос — как они взаимодействуют, особенно в контексте безопасности. ИИ трансформирует процессы: например, «вайб-кодинг» смещает роль разработчика от написания кода к управлению ИИ через промты, что напоминает менеджерские функции.

- Практика применения ИИ

- ИИ эффективен в рутинных задачах — миграция кода между СУБД, адаптация legacy-кода, генерация простых скриптов. Однако для сложных задач (архитектура, низкоуровневая оптимизация) ИИ требует глубокого контроля из-за риска галлюцинаций. Внедрение в ОС пока ограничено интерфейсным уровнем («помощники»), но в перспективе может затронуть ядро (оптимизация планировщика, изоляция драйверов).

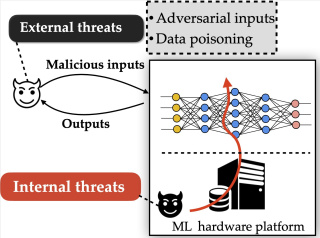

- Угрозы безопасности и управление доверием

- Основные риски:

- Отравление данных и уязвимости к промт-инъекциям.

- Недостоверность результатов: галлюцинации ИИ требуют верификации кода.

- Утечки контекста: корпоративные секреты при использовании облачных ИИ-сервисов.

Решения включают гибридные подходы: комбинация ИИ с классическими методами (статический анализ, sandbox), изоляция критических компонентов ОС, разработка стандартов для ИИ-агентов.

- Организационные и кадровые вызовы

- Квалификация: ИИ не заменяет инженеров, но меняет навыки — акцент смещается на архитектуру, промт-инженерию и валидацию результатов.

- Подготовка кадров: риск «пропуска» junior-стадии при использовании ИИ требует пересмотра обучения (фокус на проектной работе, этике взаимодействия с ИИ).

- Культура разработки: важность код-ревью и CI/CD-пайплайнов для контроля сгенерированного кода.

ИИ — мощный инструмент, но его интеграция в ОС и критическую инфраструктуру требует сбалансированного подхода: сочетания инноваций с «конструктивной безопасностью» (изоляция, верификация), адаптации процессов и сохранения человеческого контроля над сложными решениями.

Видео

Стенограмма

![]() Андрей Духвалов: Так, еще раз спасибо. Меня зовут Андрей Духвалов. Я вице-президент лаборатории Касперского. Отвечаю за перспективные технологии 💻🦾⚛🔬.

Приходится сталкиваться с такими вещами, как искусственный интеллект 🤖🧠🦾. Куда деваться? И хотелось бы поговорить сегодня, как эти два тренда, мощнейших тренда…, я имею в виду операционные системы 🖥💻 и искусственный интеллект 🤖🧠, как явление в жизни, как явление в нашей социальной жизни, технологической жизни и вообще общественной, и вообще везде.

Андрей Духвалов: Так, еще раз спасибо. Меня зовут Андрей Духвалов. Я вице-президент лаборатории Касперского. Отвечаю за перспективные технологии 💻🦾⚛🔬.

Приходится сталкиваться с такими вещами, как искусственный интеллект 🤖🧠🦾. Куда деваться? И хотелось бы поговорить сегодня, как эти два тренда, мощнейших тренда…, я имею в виду операционные системы 🖥💻 и искусственный интеллект 🤖🧠, как явление в жизни, как явление в нашей социальной жизни, технологической жизни и вообще общественной, и вообще везде.

Если говорить про операционные системы, этот тренд начался в 1955 году. 70 лет. IBM — первая электронная вычислительная машина в том виде, как мы это привыкли понимать. Она, хотя, конечно, раньше другая была, но она в 45-м году появилась, IBM. И 10 лет они жили без операционных систем. Мнение ученых, историков сходится в то, первая операционная система, как операционная система, появилась в 55-м году. И кто бы, вы думаете, её изобрёл? General Motors. У них была IBM-овская машина IBM-овская, и там софт назывался «Монитор обращений». Они решили, что этого мало, и над этим монитором нарисовали какой-то слой вместе с North American Aviation. Две компании участвовали. И вот это считается первой ОС GM-NAA I/O. Система ввода-вывода.

Это один тренд. Чем он характеризуется? Ему уже сейчас 70 лет. И я могу смело дать прогноз — ещё 50 лет вперёд операционная система будет по-прежнему развиваться. Они не быстрые — срок жизни операционной системы, «как молния прилетела», 20 лет. Те, которые успешные, да. А те, которые более успешные, они побольше. То есть они все развиваются очень медленно.

А что касается искусственного интеллекта? Теоретическая база, ей тоже уже лет достаточно. Искусственный интеллект появился быстро и настолько быстро занял вообще, думы миллионов людей, общественное пространство и всё остальное. И те технологии, которые живут внутри этого тренда, они их характеристическое время иногда бывает два-три месяца, иногда полгода.

Иногда технологии вспыхивают и устаревают, а в течение года одного, я имею в виду внутри искусственного интеллекта, совершенно полностью по характеристикам, отличаются от операционных систем.

Но, тем не менее, по своей мощности, по своему воздействию на окружающую среду, этот тренд не менее мощный, чем операционная система. И наша задача сегодня — посмотреть, как они пересекаются. Где у них пересечение у этих трендов? И как они пересекаются? И что нам… Какие выводы мы сможем сделать из этого? И что нам теперь делать?

И, я считаю, еще более мощный тренд, чем операционные системы. Это программирование itself. Сам подход, методологии, языки программирования. Бизнес-процессы даже. Программирование, как вы понимаете, родилось ещё раньше, чем операционные системы. Нет оснований полагать, что оно когда-то закончится. Хотя с искусственным интеллектом это уже не так однозначно. Там все эти, не буду их пересчитывать, но всяких «программирований» у нас сотни разных.

Например, low-code, типа мышкой нащелкал, и это, тоже программирование. А сейчас с искусственным интеллектом… Это в качестве примера, как искусственный интеллект пересекается и модифицирует те процессы, которые там до него были. Сейчас это называется вайб-кодинг, «Кодирование от души» 🎧🧘💻🌀🤖👌. Тут прямо важно принципиально, что программисты теперь не кодируют, а управляют процессом создания. Кидаешь какой-то промпт, получаешь результат, посмотрел, потестировал, внес изменения, потом уточняющий промпт. И этот процесс схож с менеджментом. То есть сам девелопер становится человеком, который управляет кодированием. Сам не кодирует, а управляет кодированием. Наша задача — посмотреть, как это всё пересекается. Я намерен и эту тему добавить, усложнил нашу задачу сегодня. Пересекаться у нас теперь будет три темы.

И давайте попробуем, как пойдёт.

Выступать будем коротко, потому что нас сегодня очень много. И я хотел бы не по одному вопросу вам задать, и еще хотел бы послушать, как на наше высказывание реагирует аудитория, задает вопросы и так далее.

Хочу представить.

-

Сергей Аносов: руководитель отдела продуктовой экспертизы «Открытая мобильная платформа».

Сергей Аносов: руководитель отдела продуктовой экспертизы «Открытая мобильная платформа». -

Егор Васин: специалист отдела технологий защиты вычислительных сетей НПП «Криптософт».

Егор Васин: специалист отдела технологий защиты вычислительных сетей НПП «Криптософт». - Анна Кан, которая к нам скоро подойдёт (так и не подошла 🤷♀️), заместитель генерального директора в ВНИИТУ.

-

Николай Костригин: базальт СПО, руководитель отдела безопасности разработки ПО.

Николай Костригин: базальт СПО, руководитель отдела безопасности разработки ПО.

Кстати, да, ещё тут безопасность 🗿🐙 приплетается. Это вообще просто жуть какая-то 👹👺

-

Михаил Новоселов: ведущий системный инженер-программист в НТЦ IT РОСА.

Михаил Новоселов: ведущий системный инженер-программист в НТЦ IT РОСА. -

Екатерина Свиридова: руководитель экспертизы по сопровождению СУБД Департамента развития платформы данных «Газпромбанк». Также представляет РЭУ Плеханова, базовую кафедру цифровой экономики Института развития информационного общества.

Екатерина Свиридова: руководитель экспертизы по сопровождению СУБД Департамента развития платформы данных «Газпромбанк». Также представляет РЭУ Плеханова, базовую кафедру цифровой экономики Института развития информационного общества. -

Егор Смирнов: руководитель проектов по внедрению искусственного интеллекта «Ред Софт».

Егор Смирнов: руководитель проектов по внедрению искусственного интеллекта «Ред Софт». -

Константин Сорокин: руководитель исследовательской группы по разработке и применению инструментов искусственного интеллекта в программной инженерии.

Константин Сорокин: руководитель исследовательской группы по разработке и применению инструментов искусственного интеллекта в программной инженерии.

Хорошо, я постараюсь задать вопросы в рамках предметных интересов. Но тем не менее, там, если у выступающих будут желания, так, общие, философские, назовём его так, вопросы обсудить, конечно, всегда пожалуйста. Процесс разработки программных продуктов сейчас сильно изменяется. Так вот, какие задачи в области информационных технологий и информационной безопасности уже сейчас можно делегировать искусственному интеллекту и какая квалификация человека при этом требуется. Попрошу на этот вопрос ответить Михаила Новоселова.

![]() Михаил Новоселов: Здравствуйте. По моим наблюдениям, сейчас так называемый вайб-кодинг, он не совсем работает. Может быть, я просто не умею им пользоваться. Но когда я прошу искусственный интеллект написать что-то сложное, он обычно пишет что-то такое, что сложно заставить работать. То есть, с ним нужно очень долго общаться, и, может быть, он что-то напишет. Если ему делегировать какую-то простую задачу, которая имеет максимально конкретные входные данные, конкретный алгоритм, конкретные выходные данные, то вполне себе.

Михаил Новоселов: Здравствуйте. По моим наблюдениям, сейчас так называемый вайб-кодинг, он не совсем работает. Может быть, я просто не умею им пользоваться. Но когда я прошу искусственный интеллект написать что-то сложное, он обычно пишет что-то такое, что сложно заставить работать. То есть, с ним нужно очень долго общаться, и, может быть, он что-то напишет. Если ему делегировать какую-то простую задачу, которая имеет максимально конкретные входные данные, конкретный алгоритм, конкретные выходные данные, то вполне себе.

Например, мне недавно нужно было написать довольно простую программу, которая считывала CSV-файл с логом, немного его преобразовывала. Там дату переставляла из последней колонки в первую и меняла формат даты. И там ещё некоторое преобразование делала. Я попросил «Искусственный интеллект», причём наш российский, Гигачат сбербанковский, написать такую программу на Go. Она и написала. С первой попытки. Простой компактный код, использовала встроенный в Go импорт CSV. Оно всё заработало. Но когда пробую написать что-то более сложное, то обычно с первого раза не получается, с второго, с третьего обычно тоже.

И здесь я бы сказал, что мы, программисты как были инженерами, так ими и остаёмся, потому что искусственный интеллект за нас всё, по крайней мере, на его текущем этапе развития, не продумает.

Архитектуру он может… какие-то типовые архитектурные решения подсказать, о которых он, там, в интернете прочитал? Но не факт, что эти решения нам хорошо подходит. Поэтому мы как проектировали программу, так и продолжим проектировать. А если мы какой-то кусок кода, там, какую-то функцию, какой-то модуль отдадим написать «ИИ», то от этого, мне кажется, пока что плюс-минус ничего не меняется. Потому что если человек совсем не умеет программировать, он не сможет нормально пользоваться результатами ИИ-труда, и им управлять вообще. А если человек умеет программировать, то ему, в принципе, плюс-минус всё равно, какое за программирование он при необходимости разберётся. То есть, сейчас ИИ хорошо справляется с ускорением решения типовых задач. Он же что-то принципиально новое не изобретает, он пересказывает то, что он знает. Поэтому, на мой взгляд, его использование с умом вполне уместно, оно вполне может ускорять работу, но человека полностью не заменяет.

И ещё, хорошо подходит там, где у человека вступает в силу человеческий фактор, например, обработка больших данных, там какая-нибудь большая табличка, человек её глазом смотрит, может что-то не заметить. И ему в этом может помочь. Но поскольку вероятность галлюцинаций, что ИИ что-то покажется, что не соответствует реальности высока, то, скорее всего, будет уместно всё равно вручную проверить его результаты. Но, тем не менее, он всё равно может помочь. Вот такие задачи сейчас, на мой взгляд, неплохо можно ему делегировать. А дальше поживём, посмотрим, как он будет развиваться.

![]() Андрей Духвалов: Да, интересно. То есть, даёшь задание как разработчику, если это в обычной жизни, и проверяешь, не галлюцинирует ли он. Да, хорошая задача для менеджеров.

Андрей Духвалов: Да, интересно. То есть, даёшь задание как разработчику, если это в обычной жизни, и проверяешь, не галлюцинирует ли он. Да, хорошая задача для менеджеров.

Коллеги, прошу прощения, я, по-моему, не всех представил. Павел Мозгов, заместитель директора дирекции внедрения и сопровождения группы «Астра». Прошу прощения.

Искусственный интеллект во все стороны претендует на то, чтобы быть представленным вообще во всех направлениях деятельности, где присутствует человек, и даже там, где он не присутствует. В частности, cистемы искусственного интеллекта… — я не ожидал этого, но они начинают присутствовать даже в ответственных информационных системах, промышленных системах. Я хотел бы задать Екатерине вопрос — А что вы думаете по поводу использования искусственного интеллекта при миграции систем, использование искусственного интеллекта при миграции информационных систем в АСУ-ТП на системы отечественного производства?

![]() Екатерина Свиридова: Нет, он работает. Когда мы говорим, например, о больших корпоративных системах хранения данных, в большинстве наших случаев в банковской системе, и не только в ней, вся эта система построена на проприетарных западных системах, и последние тренды, в том числе и в законодательстве — это переход на российское импортозамещение. Наши российские вендоры, на самом деле, в этом направлении достаточно сильно преуспели. И помимо того, что они предоставляют полноценный функционал тех систем, которые мы импортозамещаем, они ещё и развиваются. В том числе это внедрение искусственного интеллекта в свои продукты. Когда мы говорим о импортозамещении, мы понимаем, что это не только огромный массив данных, который измеряется в петабайтами, которые нужно перенести, это ещё и вся бизнес-логика, которая была на старой промышленной системе. Это процедуры, это функции, которые написаны на например, на синтаксисе языка с СУБД Oracle. Когда мы переносим это на GreenPlum, это уже становится несколько тысяч функций, которые написаны на другом языке, на другом синтаксисе. И у нас стоит высокая и сложная задача. Нам необходимо перенести весь этот код с одного языка на другой, и причём так, чтобы у нас не поменялась наша бизнес-функция. Результаты, которые у нас были на старой системе, у нас должны быть такие же на новой, без каких-либо изменений. Поэтому это огромная тяжёлая задача, и здесь достаточно сильно приходит на помощь тот же самый искусственный интеллект.

У вендоров сейчас, на самом деле, «проработки». Это ещё не промышленное решение, но оно достаточно быстро развивается, и на него возложены большие надежды. Когда на вход мы подаём наш старый код, наши старые функции процедуры, и он помогает нам, только на текущий момент помогает, не полностью снимает ответственность, но носит существенный вклад в эту работу. И, соответственно, у нас уже не десятки программистов и не тысячи часов на эту работу, а всё переходит в единицы и сотни. Спасибо.

Екатерина Свиридова: Нет, он работает. Когда мы говорим, например, о больших корпоративных системах хранения данных, в большинстве наших случаев в банковской системе, и не только в ней, вся эта система построена на проприетарных западных системах, и последние тренды, в том числе и в законодательстве — это переход на российское импортозамещение. Наши российские вендоры, на самом деле, в этом направлении достаточно сильно преуспели. И помимо того, что они предоставляют полноценный функционал тех систем, которые мы импортозамещаем, они ещё и развиваются. В том числе это внедрение искусственного интеллекта в свои продукты. Когда мы говорим о импортозамещении, мы понимаем, что это не только огромный массив данных, который измеряется в петабайтами, которые нужно перенести, это ещё и вся бизнес-логика, которая была на старой промышленной системе. Это процедуры, это функции, которые написаны на например, на синтаксисе языка с СУБД Oracle. Когда мы переносим это на GreenPlum, это уже становится несколько тысяч функций, которые написаны на другом языке, на другом синтаксисе. И у нас стоит высокая и сложная задача. Нам необходимо перенести весь этот код с одного языка на другой, и причём так, чтобы у нас не поменялась наша бизнес-функция. Результаты, которые у нас были на старой системе, у нас должны быть такие же на новой, без каких-либо изменений. Поэтому это огромная тяжёлая задача, и здесь достаточно сильно приходит на помощь тот же самый искусственный интеллект.

У вендоров сейчас, на самом деле, «проработки». Это ещё не промышленное решение, но оно достаточно быстро развивается, и на него возложены большие надежды. Когда на вход мы подаём наш старый код, наши старые функции процедуры, и он помогает нам, только на текущий момент помогает, не полностью снимает ответственность, но носит существенный вклад в эту работу. И, соответственно, у нас уже не десятки программистов и не тысячи часов на эту работу, а всё переходит в единицы и сотни. Спасибо.

![]() Андрей Духвалов: А сейчас только что обсуждали вопрос с галлюцинациями. Как вы представляете, боретесь ли вы как-то, предвидите, что…

Андрей Духвалов: А сейчас только что обсуждали вопрос с галлюцинациями. Как вы представляете, боретесь ли вы как-то, предвидите, что…

![]() Екатерина Свиридова: Сейчас системы искусственного интеллекта… уже все знают, что они галлюцинируют. А тот код, который они генерируют, может быть, он начнёт галлюцинировать? Вполне. Поэтому я и говорю, что мы не можем полностью положить ответственность на искусственный интеллект, но он существенно облегчает нам задачу. Могу, например, ещё немножко привести пример. Он немножко от того, о чём мы разговаривали. Например, практическая задача.

Екатерина Свиридова: Сейчас системы искусственного интеллекта… уже все знают, что они галлюцинируют. А тот код, который они генерируют, может быть, он начнёт галлюцинировать? Вполне. Поэтому я и говорю, что мы не можем полностью положить ответственность на искусственный интеллект, но он существенно облегчает нам задачу. Могу, например, ещё немножко привести пример. Он немножко от того, о чём мы разговаривали. Например, практическая задача.

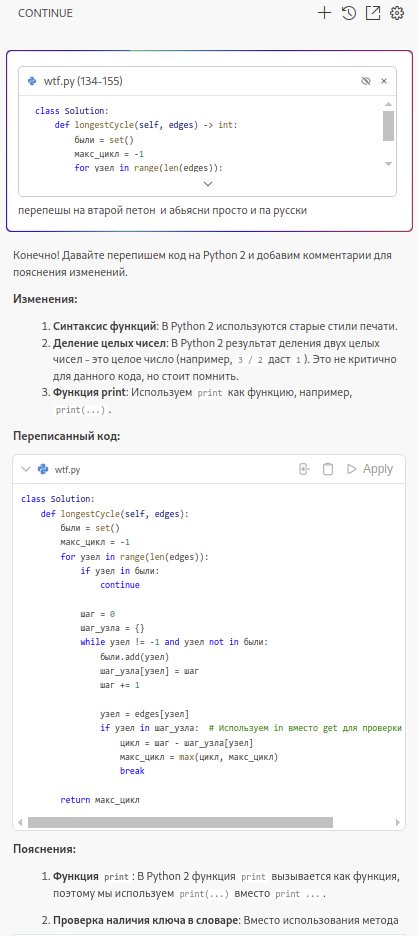

Как всегда, если мы говорим про, банковскую сферу, у нас есть ограничение вендора, у нас есть ограничение службы безопасности на те продукты, которые мы используем. Например, у меня стоит задача. Мне необходимо протестировать механизм Clickhouse, использование пользовательских функций. Так как у нас установлено вендорское решение, у нас стоит там Zookeeper, Python, версия которого 2.7.5. Синтаксис которого, я знаю только в версии после трёх. Стоит такая задача, которой даже не хочется заниматься. Мне нужно переработать свой код на версию 2.7. И каково было моё удивление и счастье, когда, в принципе, это можно было всё скормить искусственному интеллекту. Отличная задача для искусственного интеллекта. Да. Он предоставил мне, в принципе, очень достаточно работоспособный вариант, и мне необходимо было только его проверить, и убедиться, что он всё выдал без галлюцинаций. Ну то есть в прошлой жизни это было 20 джунов, да? Да. Да, но учёт и контроль. Учёт и контроль. Спасибо.

![]() Андрей Духвалов: Спасибо. Раз уж мы затронули такую тему, как какие-то проблемы с использованием, я хочу у Егора спросить про функциональные угрозы, характерные для искусственного интеллекта. Как относиться к этой проблеме?

Андрей Духвалов: Спасибо. Раз уж мы затронули такую тему, как какие-то проблемы с использованием, я хочу у Егора спросить про функциональные угрозы, характерные для искусственного интеллекта. Как относиться к этой проблеме?

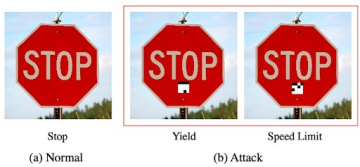

![]() Егор Васин: Да, всем добрый день. Всех приветствую. Угрозы, безусловно, есть. В первую очередь, это угрозы, связанные с отравлением данных. То есть известная проблема, когда злоумышленник может внедриться в обучающий датасет и расставить, например, недоброжелательные метки. То есть одно изображение, которое будет скармливаться искусственному интеллекту, может… одно изображение, которое относится к одному классу, ранее установленному, может быть отнесено к какому-то другому. И уже в ходе работы, соответственно, на модели искусственного интеллекта, наш датасет может быть воспринят неверно.

Егор Васин: Да, всем добрый день. Всех приветствую. Угрозы, безусловно, есть. В первую очередь, это угрозы, связанные с отравлением данных. То есть известная проблема, когда злоумышленник может внедриться в обучающий датасет и расставить, например, недоброжелательные метки. То есть одно изображение, которое будет скармливаться искусственному интеллекту, может… одно изображение, которое относится к одному классу, ранее установленному, может быть отнесено к какому-то другому. И уже в ходе работы, соответственно, на модели искусственного интеллекта, наш датасет может быть воспринят неверно.

Это, действительно, даёт широкие возможности для злоумышленника. И, наверное, в настоящее время каких-то готовых решений, которые могут позволить эту проблему предотвратить, не существует. Есть соответствующие рекомендации, какого-то такого методического плана, они, еще не зарегистрированы, которые касаются перекрестной проверки обучающих данных перед к началом обучения модели искусственного интеллекта. Есть какие-то эксперты предметной области, непосредственно разбирающиеся в данных вопросах, они должны просмотреть датасет, проверить корректность соотношения соответствующих объектов с соответствующим метком класса и убедиться, что предоставленные данные не отравлены.

Также здесь, наверное, стоит помнить о том, что искусственный интеллект решает ту задачу, которую ему поставили, и не всегда эта задача может быть корректно поставлена. То есть искусственный интеллект, он решает какую-то конкретную задачу. Задачу классификации, задачу кластеризации, задачу регрессии, он способен общаться только в этом контексте. И очень многое, на самом деле, зависит именно от того, насколько именно корректно поставлена исходная задача, насколько верно даны входные данные.

Такой мой ответ на ваш вопрос. Да, надо теперь контролировать не только качество кода, но и качество задачи, которые ты ставишь, качество промтов. И хорошая фраза ещё вчера прозвучала — понравилась мысль от одного из выступающих, то, что нужно контролировать, так называемую контролируемую зону, то есть не пускать злоумышленника в тот сектор, где происходит разметка данных.

Наверное, это такое действительно порядочное, грамотное и громоздкое решение.

![]() Егор Смирнов: Хотел что-то добавить. Да. Вы попросили высказаться Егору, но не уточнили, какого, поэтому я тоже вкину.

Егор Смирнов: Хотел что-то добавить. Да. Вы попросили высказаться Егору, но не уточнили, какого, поэтому я тоже вкину.

![]() Андрей Духвалов: А, я извиняюсь.

Андрей Духвалов: А, я извиняюсь.

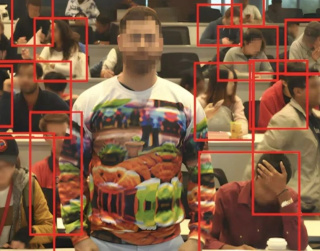

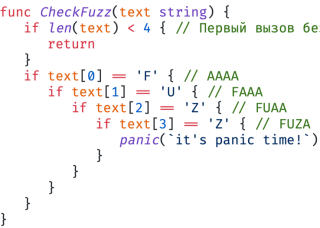

![]() Егор Смирнов: Да, я просто хотел привести интересный пример, который я услышал на другой конференции, например, с нейросетями, которые распознают изображение. Нам коллега показывал. Он пришёл на конференцию в футболке с очень странным каким-то абстрактным принтом. И после этого он сказал, что это была на самом деле пасхалка.

Картинка, которая обманывает определённые алгоритмы. То есть, я просто хочу подсветить, насколько могут быть серьёзные последствия. Например, если у вас, там, алгоритм, например, должен распознавать людей, чтобы, например, автономные автомобили мог объехать, то, знаете, злоумышленник, подарив такую футболку кому-нибудь, может натворить много чего нехорошего.

Егор Смирнов: Да, я просто хотел привести интересный пример, который я услышал на другой конференции, например, с нейросетями, которые распознают изображение. Нам коллега показывал. Он пришёл на конференцию в футболке с очень странным каким-то абстрактным принтом. И после этого он сказал, что это была на самом деле пасхалка.

Картинка, которая обманывает определённые алгоритмы. То есть, я просто хочу подсветить, насколько могут быть серьёзные последствия. Например, если у вас, там, алгоритм, например, должен распознавать людей, чтобы, например, автономные автомобили мог объехать, то, знаете, злоумышленник, подарив такую футболку кому-нибудь, может натворить много чего нехорошего.

Ну, я такой уже прям совсем уже страшный пример привёл. К чему? Если мы имеем дело не с классическими алгоритмами машинного обучения, например, с нейросетями, внутри которых мы не можем заглянуть и посмотреть, каким признакам какие веса были приданы и так далее, то есть которые работают по признаку чёрного ящика, мы здесь в ближайшее время пока, мне кажется, не сможем обойтись без человеческого надзора в той или иной форме.

![]() Андрей Духвалов: Спасибо. Да, это точно. Эта мысль у нас должна красной нитью проходить через все наши… наши обсуждения, мне кажется. Что учёт и контроль.

Андрей Духвалов: Спасибо. Да, это точно. Эта мысль у нас должна красной нитью проходить через все наши… наши обсуждения, мне кажется. Что учёт и контроль.

И я бы хотел у Николая… У нас один Николай Констригин. А какие инструменты должны быть? Каковы правильные инструменты должны быть, во-первых, для использования искусственного интеллекта в разработке, и какие инструменты должны контролировать искусственный интеллект? Как-то не слишком ли я тот самый умный? Такой вопрос.

![]() Николай Костригин: Понятно, что софт проник уже во все сферы жизни, доверие к нему, как в медицинском, банковском, в технологическом секторе должно быть обеспечена путём проведения определённого вида исследований, известных как S-DLC или по российской устоявшейся практике РБПО. Соответственно, софт, участвующий и в разработке моделей и в управлении ими, тоже должен подвергаться таким же исследованиям.

Николай Костригин: Понятно, что софт проник уже во все сферы жизни, доверие к нему, как в медицинском, банковском, в технологическом секторе должно быть обеспечена путём проведения определённого вида исследований, известных как S-DLC или по российской устоявшейся практике РБПО. Соответственно, софт, участвующий и в разработке моделей и в управлении ими, тоже должен подвергаться таким же исследованиям.

В принципе, сейчас эту проблему уже осознали. Месяц назад проходила конференция, посвященная безопасности искусственного интеллекта. В России уже обозначен «Вектор развития программы развития технологий искусственного интеллекта 2030 года». Создана рабочая группа по разработке критериев и инструментов исследования искусственного интеллекта. Здесь присутствует коллега из ИСПРАН. Я думаю, не отнимать у них хлеб. Наверное, они лучше об этом расскажут. Но в своей практике исследования кода, который входят в состав операционной системы, мы уже не можем игнорировать наличие инструментов искусственного интеллекта, поскольку исследуем это поле и пытаемся внедрять какие-то наработки.

![]() Андрей Духвалов: Спасибо. То есть статический динамический анализ кода теперь будет осуществлять искусственный интеллект.

Андрей Духвалов: Спасибо. То есть статический динамический анализ кода теперь будет осуществлять искусственный интеллект.

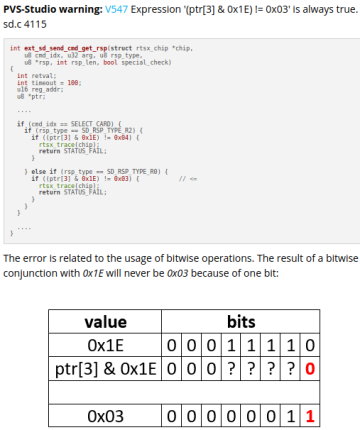

![]() Николай Костригин: Нет, здесь статический анализ, насколько мне известно, он достаточно как раз из-за галлюцинирования плохо осуществляет. Доверять этим результатам довольно сложно. А «дедуплицировать сработки», наверное, можно.

Николай Костригин: Нет, здесь статический анализ, насколько мне известно, он достаточно как раз из-за галлюцинирования плохо осуществляет. Доверять этим результатам довольно сложно. А «дедуплицировать сработки», наверное, можно.

![]() Андрей Духвалов: То есть выявлять плохое… Кластеризировать… Похожее, да. Это задача для искусственного интеллекта, классическая задача для искусственного интеллекта, да. Хорошо. Раз уже заговорили про ИСПРАН и инструменты разработки, Константин, подскажите, тогда, как… чего нас ждёт?

Андрей Духвалов: То есть выявлять плохое… Кластеризировать… Похожее, да. Это задача для искусственного интеллекта, классическая задача для искусственного интеллекта, да. Хорошо. Раз уже заговорили про ИСПРАН и инструменты разработки, Константин, подскажите, тогда, как… чего нас ждёт?

![]() Константин Сорокин: Спасибо за слово. Во-первых, на фоне предыдущих вопросов хочется немножко добавить контекста.

Константин Сорокин: Спасибо за слово. Во-первых, на фоне предыдущих вопросов хочется немножко добавить контекста.

Сейчас, как мне кажется, важно подразделять два направления. Изначально мы все смотрели на проблемы безопасности, доверия и участия алгоритмов машинного обучения в повседневной разработке и так далее с точки зрения именно классических подходов, то есть до появления масштабных языковых моделей, которые сейчас есть. И, соответственно, за последние годы, там, все понимают, что откуда растет, промпт-инженерия вся, чатGPT, квоты, открытые модели, там, появляются от коллег и, соответственно, наших собственные, там, Сберский и Яндекс.

У них совершенно другие проблемы безопасности. И тут важно понимать, что на самом деле в инструментах разработки или, там, при разработке ассистентов, которых мы используем для программирования, в том числе в контексте, которые помогают разработчикам писать код или ревьюить код, или, не знаю, писать тесты, или, может быть, даже в каком-то смысле проводить дебаггинг — они все построены и более-менее хорошо приемлемо работают и действительно помогают, там, в повседневной жизни программистам. Это инструменты, построенные на больших языковых моделях, по моему субъективному опыту.

Смотреть на проблемы доверия надо в двух разных направлениях. Есть большой пласт скажем так, проблем, которые связаны именно с классическими алгоритмами и подходами, которые там работают. Уже упоминали сегодня, проблемы, которые связаны с отравлением обучающих данных. Там есть классические подходы, по тому, как это делать и так далее. А есть совершенно другие классы проблем, которые связаны именно с большими языковыми моделями. Там проблемы, связанные с промпт-инъекциями, с использованием подходов, когда мы пытаемся пытаемся спрашивать у моделей, просим её сгенерировать эксплойты по каким-то примерам известным и так далее.

Мой первый пункт — что надо проводить такое разграничение, и понимать, что на самом деле все текущие и будущие инструменты помощи для разработчиков, они будут построены именно на больших языковых моделях, соответственно, обладающих своими проблемами безопасности и так далее.

А второе, я очень хочу согласиться с тем пунктом по поводу того, нас, как программистов, в ближайшее время, скорее всего, никто из виртуальных ассистентов не заменит, по крайней мере, на горизонте пару лет. Точно. Потому что уже правильно сказали, что существует класс задач, которыми искусственный интеллект справляется хорошо даже у большей языковой модели.

Это, допустим, если взять какие-то простые задачи, которые способны что-то генерировать, и так, что человек в этом не должен принимать участие. Как Екатерина сказала, такое вот все. То есть когда, не нужно вообще принимать никакого… не выполнять никакой верификации. Либо, там, нужно какое-то частичное участие разработчика. А существует второй класс задач, где всё-таки требуется эксперт, полноценный эксперт, на какой-то субъективной практике. Если вы занимаетесь анализом проблем, которые были найдены, статическим анализом или динамическим анализом, например, в том же самом коде ядра.

Проблемы бывают иногда нетривиальные, и как понять, где корень зла, и как эту проблему решить, как её правильно исправить, как правильно пофиксить — бывает нетривиально. Соответственно, вы можете использовать ассистента, который с вами вместе будет, по сути, что называется, брейнштормить эту проблему.

Надо понимать, что всё не заканчивается стандартными подходами на уровне «А давайте мы попробуем сейчас…». Сделали один промт, там, посмотрели на ответ, там, продолжили общение в чате и что-то там… Как-то так итеративно движемся.

Нужно понимать, что сейчас появляются ещё такие страшные штуки, как агенты-мультиагенты, которые, по сути, представляют собой буквально виртуальных ассистентов, когда есть модель, у неё есть какой-то набор инструментов, тот же самый статический анализ, динамический анализ, возможность генерировать код и исполнять его в sandbox-окружении.

Это тоже совершенно отдельный класс проблем, но мы все туда идём.

Я имею в виду проблемы безопасности. Резюмирую этот пункт по поводу того, что эксперты, которые занимаются, по крайней мере, написанием кода в критически важной инфраструктуре или в критически важных областях, или, там, просто системным программированием, наверное, в целом, в ближайшее время точно никто никого не заменит, и там инструменты разработки нужны именно в качестве ассистентов. Это какое-то, «парное программирование» виртуальное, которое помогает именно анализировать какие-то проблемы, брейнштормить и, соответственно, как-то правильно направлять.

И одновременно с этим появляется это направление агентов, которые, ну как по сути … тут было тоже правильно сказано, что не надо пытаться решать искусственным интеллектом задачи, которыми он решает плохо, или когда существуют классические инструменты, которые его решают хорошо.

Если у нас есть статический анализ и есть динамический анализ, не надо пытаться нейронками его заменять. Надо пытаться эти инструменты объединять. И это то, за что мы всегда, внутри команды или там внутри института, может быть, там, где-то на каких-то выступлениях тоже мы всегда пытались эту идею доносить, что мы должны создавать комплементарные инструменты, которые позволят друг друга усиливать.

Если мы говорим, например, про статический анализ или динамический анализ, там есть определённые проблемы. Например, генерация фаззинг-таргетов. Есть статический анализ или динамический анализ, когда мы не можем понять, в чём суть ошибки. Мы можем подключить сюда, искусственный интеллект в качестве ассистента и попробовать помочь как-то решить эти проблемы, используя разные данные. Историю разработки, историю предыдущих проблем и так далее.

А с другой стороны, мы можем пытаться усиливать искусственный интеллект классическими инструментами — статическим анализом и динамическим анализом.

Если мы, например, генерируем какой-то код, поскольку все модели большие обучаются на данных из интернета, никто не застрахован от того, что оно сгенерирует вам уязвимый код или код, который при добавлении в операционную систему приведет к каким-то уязвимостям на более высоком уровне проекта.

И тогда нужно подключать сюда статический динамический анализ, чтобы верифицировать тот код, который сгенерировался языковыми моделями или искусственным интеллектом.

Это, наверное, третий основной пункт, о котором я хотел сказать.

На самом деле, у меня есть там ещё разные мысли, но я боюсь, что я слишком долго говорю, поэтому да…

![]() Андрей Духвалов: Мы ещё один круг сделаем, я уверен. Правда, очень интересно. И пока вы говорили, у меня ещё один вопрос появился. Но я вам задам его всем на следующей итерации. Прям, мне кажется, очень серьёзный вопрос. Я его в первый раз только осознал.

Но пока хочу вернуться сейчас обратно в контекст операционных систем. Мы всё-таки про операционные системы. Сейчас мы говорили про общие такие подходы к программированию. Что, собственно, я с самого начала понимал, что мы этого вопроса никак не избежим.

Андрей Духвалов: Мы ещё один круг сделаем, я уверен. Правда, очень интересно. И пока вы говорили, у меня ещё один вопрос появился. Но я вам задам его всем на следующей итерации. Прям, мне кажется, очень серьёзный вопрос. Я его в первый раз только осознал.

Но пока хочу вернуться сейчас обратно в контекст операционных систем. Мы всё-таки про операционные системы. Сейчас мы говорили про общие такие подходы к программированию. Что, собственно, я с самого начала понимал, что мы этого вопроса никак не избежим.

Тем не менее, к Сергею вопрос. А как, собственно, влиять на безопасность ОСБУ и искусственный интеллект? С каких сторон? Обозначить проблемы, и потом, что делать с этими проблемами.

![]() Сергей Аносов: Доброе утро, коллеги! Всех рад видеть. Андрей Петрович, перед тем, как ответить на этот вопрос… В принципе, все участники дискуссии, они так или иначе, в ответе на ваши вопросы, затрагивали проблему доверия к искусственному интеллекту. Что искусственный интеллект глючит, «он не может решить проблему», «ему нельзя доверять».

Если посмотреть, не с точки зрения безопасности, возьмём классическую задачу статического анализа — это не самая интересная задача для разработчика. Будем честны, для разработчика ОС — это не самая интересная задача.

Сергей Аносов: Доброе утро, коллеги! Всех рад видеть. Андрей Петрович, перед тем, как ответить на этот вопрос… В принципе, все участники дискуссии, они так или иначе, в ответе на ваши вопросы, затрагивали проблему доверия к искусственному интеллекту. Что искусственный интеллект глючит, «он не может решить проблему», «ему нельзя доверять».

Если посмотреть, не с точки зрения безопасности, возьмём классическую задачу статического анализа — это не самая интересная задача для разработчика. Будем честны, для разработчика ОС — это не самая интересная задача.

![]() Андрей Духвалов: В этом и кайф — сгрузить всю рутину на ИИ.

Андрей Духвалов: В этом и кайф — сгрузить всю рутину на ИИ.

![]() Сергей Аносов: Я как раз и веду к этому, что очень часто на эту задачу берут или назначают людей, которые, студенты, условно, стажёры…

Не такое дорогое, как время разработчиков более опытных, да. И возникает вопрос. Вот искусственный интеллект сказал, сам он говорит, «Сделай разметку, сделай определённый вывод». У нас есть какая-то степень доверия к нему, да, или недоверия.

Условно, и Джун, или студент. Он тоже это… он тоже сделал. Насколько мы ему верим?

Сергей Аносов: Я как раз и веду к этому, что очень часто на эту задачу берут или назначают людей, которые, студенты, условно, стажёры…

Не такое дорогое, как время разработчиков более опытных, да. И возникает вопрос. Вот искусственный интеллект сказал, сам он говорит, «Сделай разметку, сделай определённый вывод». У нас есть какая-то степень доверия к нему, да, или недоверия.

Условно, и Джун, или студент. Он тоже это… он тоже сделал. Насколько мы ему верим?

Получается, что всё равно, там, кто-то будет проверять. Но первичный вот этот разбор, оценку сделает человек. И может возникнуть ситуация, когда, условно, людям мы верим, а искусственному интеллекту не верим. И человек тоже совершает ошибки. И получается так, что мы, немножко не доверяя ИИ, но веря людям, «не будем двигаться так быстро вперед, как могли бы». Это первая такая мысль. Но на самом деле, если немножко развить, то, получается, мы сейчас… практически все здесь сидящие, я не хочу никого обидеть. Сейчас посмотрю. Мы, наверное, относимся к поколению Y. Это люди, которые родились, там, в 84-й, в 2000-й год. Я не хочу никого обидеть. Очень плохо у меня с определением возраста по лицам.

![]() Андрей Духвалов: Да, у всех кто сидят 👶, а кто стоит, нет 👴.

Андрей Духвалов: Да, у всех кто сидят 👶, а кто стоит, нет 👴.

![]() Сергей Аносов: Андрей Петрович, у меня плохо с определением возраста. Характерно для людей этого поколения — это как раз, некая критичность мышления 🤔🤨. Критичность мышления, [не]доверие к экспертам 😤 и желание разобраться во всём самому🧐.

Сергей Аносов: Андрей Петрович, у меня плохо с определением возраста. Характерно для людей этого поколения — это как раз, некая критичность мышления 🤔🤨. Критичность мышления, [не]доверие к экспертам 😤 и желание разобраться во всём самому🧐.

Следующее поколение — это, там, Z, Alpha — это люди, которые уже отродились после. Я могу по своим детям 👦👧 судить. Вот они… задаешь им какой-то вопрос, они пошли, там, через три минуты приходят, говорят — есть ответ. Начинают рассказывать, я говорю — а где ты это нашел? — «YouTube включил, какой-то блогер 🤡 мне что-то рассказал» — я говорю «это же просто какой-то бред 💩, вот смотри, вот здесь вот так, вот так… куда пошел?» — «🤸Пойду другого блогера 🤹 посмотрю, который, правильный ответ даст». То есть они начинают доверять каким-то инфлюенсерам и прочим 🎭🎪. А есть ещё следующее поколение, которые родились в 25-м году, начиная с этого года, это поколение бета 👶🐸👶🍭. Это люди, которые будут расти уже вместе с агентами, вместе с агентами искусственного интеллекта. И для них то, что говорит искусственный интеллект, это будет абсолютное… 🤩🤩 Сейчас мы перейдём потихоньку как раз к операционным системам и как они будут меняться. Но люди, дети, которые родились относительно недавно, для них, там, смартфоны, искусственный интеллект — нечто, что-то абсолютное✅🤩, абсолютное доверие💯💖, да. То есть задал вопрос, и он не может ошибиться. И с этим тоже надо… Истина в последней инстанции. «Я задал вопрос, куда-то, и получил ответ. И этот ответ верный». И это, наверное, тоже проблема, с которой надо… Это безопасность данных. Там можно много интересных тем поднять 🤔 — А кто данные забирает? А какой ответ правильный? А на какую целевую аудиторию? А в какой момент времени? И получается очень и очень… сложная тема именно для будущих поколений. Искусственный интеллект и доверие к нему 🤩🙏🤖👼. А нам надо что-то с этой проблемой будет делать, безусловно. Если рассмотреть с этой точки зрения, возвращаясь к теме операционных систем, то, наверное, можно выделить в краткосрочной перспективе — сейчас, в принципе, операционные системы готовы к внедрению искусственного интеллекта на уровне API. Голосовой помощник — «Алиса, включи…», «Включи погоду, сколько времени» и прочее — это некое API, которая позволяет, там, «Поставь встречу в календаре» и прочее. Это то, что мы имеем сейчас, и на краткосроке это уже работает, интегрируется, много где появляется.

На среднесрочной перспективе у нас появятся прямо уже интегрированные, уже искусственные агенты, которые смогут, с точки зрения безопасности… будут обучаться, будут смотреть на модель поведения пользователя и пытаться что-то предсказать. Условно говоря, я оказался в магазине и с радостью бы этим пользовался. Всегда, в каком-то магазине приходишь, вдруг начинаешь искать карточку в телефоне, и я думаю «блин, кто бы мне сейчас раз по местоположению определил и сказал — вот, карточка, не ищи, бери и пользуй». Такие вещи появятся. С точки зрения безопасности искусственный интеллект и устройство будет вас запоминать, предугадывать, реагировать на «как вы держите телефон?», «как вы набираете?». И у нас ребята делали курсовой проект — моделька обучалась, и когда телефон передавали другим людям, соответственно, по углу наклона, по скорости нажатия телефон блокировался. То есть, телефон у вас украли, вырвали — всё, он заблокировался. Это вторая история.

И третья, в долгосрочной перспективе, вы говорили здесь про вайб-кодинг. Представьте, что у вас есть устройство. Я говорю с точки зрения мобильных устройств, мне это ближе. Но с точки зрения десктопа, в принципе, всё то же самое. У вас есть единое окно, в котором вы начинаете промтом генерировать для себя программы. Вы сейчас вы там можете картинку сгенерировать вместо дизайнеров, там, ещё что-то. А сможете сказать, условно, «Сделай мне программу» или «Выведи все заголовки газет». И искусственный интеллект, модельки, сгенерируют код, скомпилируют его под текущую, под нужную тебе архитектуру и разработают приложение. Это долгосрочные перспективы. Нужно работать с промтами и вообще качество восприятия промтов должно увеличиться. И проблема, что сейчас искусственный интеллект может решить качественную задачу, переводы с одной версии Python на другую или ещё что-то. А в долгосрочной перспективе будет «А напиши мне ПО». И там какой-то набор требований «я хочу, чтобы было». «Красная кнопка, чтобы мне было хорошо», «нажать на эту кнопку должно вот это происходить». Старинная мечта — «большая красная кнопка», да? И получается, что мы как бы к этому движемся.

Мы об этом у себя внутри заговорили где-то год назад. И я вижу, сейчас глава Microsoft говорит примерно то же самое, что появится искусственное… Вообще, всё взаимодействие будет через искусственный интеллект, через агентов. И буквально вчера вышло…

![]() Андрей Духвалов: И всё это на уровне операционной системы.

Андрей Духвалов: И всё это на уровне операционной системы.

И всё это на уровне операционной системы. Нет, это косвенно затрагивает, что там файзинг, статику. Это, наверное, мы там чуть попозже поговорим, про угрозы именно с точки зрения безопасности, векторов атак и прочего. Но именно с точки зрения архитектуры, разработки, там, в долгосрочной перспективе у вас будет входное окно, которое позволит вам генерировать приложение для себя, под ваши нужды. И всё ваше взаимодействие будет, так, условно …

![]() Андрей Духвалов: Персонализированное? 🫕🧘👌

Андрей Духвалов: Персонализированное? 🫕🧘👌

![]() Сергей Аносов: Да. Типа, сделал анализ ДНК 🧬🧪🔬, и под тебя пишут приложение 🤖📱.

Сергей Аносов: Да. Типа, сделал анализ ДНК 🧬🧪🔬, и под тебя пишут приложение 🤖📱.

![]() Андрей Духвалов: Да, в общем-то, да. Примерно так и есть.

Андрей Духвалов: Да, в общем-то, да. Примерно так и есть.

![]() Андрей Духвалов: Да, спасибо. Всё-таки если говорить…, мы уже сейчас говорили… я Павла хочу спросить, заговорили про операционные системы и заговорили про мультиагентные системы. И вот теперь я знаю, что Павел хочет поделиться. Как это можно вообще совместить? Что это такое? Как мы это должны понимать?

Андрей Духвалов: Да, спасибо. Всё-таки если говорить…, мы уже сейчас говорили… я Павла хочу спросить, заговорили про операционные системы и заговорили про мультиагентные системы. И вот теперь я знаю, что Павел хочет поделиться. Как это можно вообще совместить? Что это такое? Как мы это должны понимать?

![]() Павел Мозгов: Перед тем, как я буду рассказывать про мультиагентные системы, я скажу, что у меня нет таких высоких требований сейчас к искусственному интеллекту. Мы просто хотим от него всё и сразу, и сейчас, и как в том мультике, «оно что, и есть за меня будет, да»?

Павел Мозгов: Перед тем, как я буду рассказывать про мультиагентные системы, я скажу, что у меня нет таких высоких требований сейчас к искусственному интеллекту. Мы просто хотим от него всё и сразу, и сейчас, и как в том мультике, «оно что, и есть за меня будет, да»?

Я хотел поговорить с точки зрения пользовательского опыта, что здесь происходит. Та же компания «Микрософт», которая тут упоминалась… почти чуть ли не каждую неделю выходят всё новые и новые какие-то-то… Что они делают?

Тестируют новый пользовательский опыт операционной системы на всём мире и смотрят, что на самом деле будет востребовано. Да, весь мир в качестве тестеров. Что можно перенести из каких-то рутинных задач или задач, с которыми, мы не хотим соприкасаться, там, при настройке операционной системы. При каких-то использованиях каких-то приложений, при установке приложений, например, и так далее. То есть они смотрят, что можно в итоге перенести на copilot-ы. И я думаю, что в конечном итоге это отразится на изменении интерфейса. Они просто будут убирать эти ненужные, окошечки-пунктики и так далее из этой истории. Или, например, они будут понимать, что поиск в в файловой системе будет в один клик, а не бегая по этой истории. А дальше больше. Когда мы начнём привыкать к такому новому пользовательскому опыту, где нам проще воспользоваться «копайлотом» и решить какие-то такие рутинные задачи, мы захотим, чтобы это происходило и в приложениях тоже. И здесь есть такой момент, что «а как, в общем-то, обеспечить это совмещение контекста?» Потому что всё это будет строиться на ИИ-агентах, естественно. Есть заложенный функционал в «копайлот»-операционной системе, например, но есть ИИ-агенты в различных приложениях, которые свою логику имеют. И как передать этот контекст? Как из «копайлота» выполнить свою задачу и в операционной системе и в каком-то приложении? Закрыть и свою задачу в разработке, и какую-то даже бизнес-задачу?

И здесь cоздание каких-то стандартов для агентов, для разметки, для того, чтобы мы жили, в каком-то общем поле при написании этих ИИ-агентов — это очень важная история. Чтобы мы могли в итоге передавать этот контекст, был этот прозрачный путь и пользовательский опыт на всех этапах.

Я думаю, что эта история нас ещё впереди ждёт, от появления этих правил, стандартов и так далее.

![]() Андрей Духвалов: Ну, извините, такая модель, она уже не новая. Это как с мобильными телефонами, когда есть там App Store, центральный узел, который собирает всю информацию, а приложение распределяет, деплоится на мобилу, и… они всё время связаны, и они там, в App Store, анализируют наше поведение и этим тестируют. Эта модель-то примерно такая же получается, да? — Co-Pilot сидит на серваке в дата-центре где-то, к нему, там, миллион запросов. Он, ага, так, теперь вот эти запросы редкие, а эти более актуальные. Давай мы сейчас функцию такую…

Андрей Духвалов: Ну, извините, такая модель, она уже не новая. Это как с мобильными телефонами, когда есть там App Store, центральный узел, который собирает всю информацию, а приложение распределяет, деплоится на мобилу, и… они всё время связаны, и они там, в App Store, анализируют наше поведение и этим тестируют. Эта модель-то примерно такая же получается, да? — Co-Pilot сидит на серваке в дата-центре где-то, к нему, там, миллион запросов. Он, ага, так, теперь вот эти запросы редкие, а эти более актуальные. Давай мы сейчас функцию такую…

![]() Павел Мозгов: Да, как он поймёт, кому это передать? Как он поймёт, что эту задачу нужно выполнить на стороне, именно этого ИИ-агента? Как он с ним свяжется и так далее?

Павел Мозгов: Да, как он поймёт, кому это передать? Как он поймёт, что эту задачу нужно выполнить на стороне, именно этого ИИ-агента? Как он с ним свяжется и так далее?

![]() Андрей Духвалов: Да, понятно. Так, смотрите, у нас сейчас прошёл один круг. Все, там, сказали, что хотели. А, ты ещё не…

Андрей Духвалов: Да, понятно. Так, смотрите, у нас сейчас прошёл один круг. Все, там, сказали, что хотели. А, ты ещё не…

![]() Михаил Новоселов: Я бы хотел добавить про искусственный интеллект в операционных системах. Мы сейчас много чего сказали, но это, по сути дела, скорее прикладной уровень с точки зрения операционной системы. То есть, голосовые помощники и прочие — это прикладной уровень. От операционной системы, возможно, потребуются какие-то интерфейсы для взаимодействия этих вот АИ-агентов между собой. В случае Linux это, наверное, будет D-BUS.

Михаил Новоселов: Я бы хотел добавить про искусственный интеллект в операционных системах. Мы сейчас много чего сказали, но это, по сути дела, скорее прикладной уровень с точки зрения операционной системы. То есть, голосовые помощники и прочие — это прикладной уровень. От операционной системы, возможно, потребуются какие-то интерфейсы для взаимодействия этих вот АИ-агентов между собой. В случае Linux это, наверное, будет D-BUS.

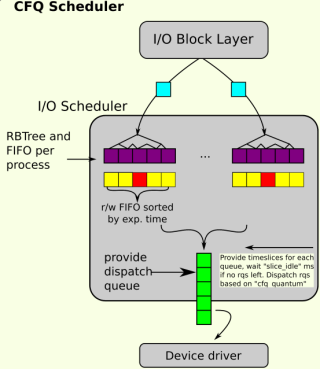

А если смотреть немного вглубь операционной системы, мне кажется, там тоже можно попробовать искусственный интеллект применить. Например, есть такая проблема, что в разных операционных системах, скажем так, немного разные алгоритмы распределения процессорного времени. То есть у нас в операционной системе запущено много процессов разных — там, одна программа, вторая, третья. В одной программе поток, в первой, в второй, в третьей. А ресурсы процесса ограничены, и планировщик в ядре операционной системы постоянно принимают решение, какому процессу сколько времени выделить? Он работает примерно так — «этому процессу дам столько-то, там, миллисекунд, потом чуть-чуть на паузу поставлю, дам другому поработать». И существуют разные алгоритмы распределения процессов на времени. Вот в ядре Linux планировщик CFQ по умолчанию, он в целом пытается честно распределить время между всеми процессами.

Это часто хорошо, но иногда имеет негативные последствия в отзывчивости приложений. Когда система сильно нагружена, а за ней работает человек, то хорошо было бы, чтобы реакция, например, на нажатие мышью человеком какую-то кнопку, не была замедлена, потому что в фоне выполняется какая-то другая операция. И у ядра операционной системы стоит задача определить, какую задачу выполнять более приоритетно, какую менее приоритетно, какую первую, какую вторую, кому сколько времени дать. Например, здесь можно было бы попробовать применить искусственный интеллект, то есть собрать какую-то телеметрию, большой объём данных, по тому, какие задачи выполняют пользователи, и попытаться на основе этого как-то улучшить интерактивность системы. То есть, поработать в сторону того, чтобы планировщик процессного времени принимал решение исходя из предугадывания задач пользователя или каких-то других обстоятельств. И, возможно, это я сходу сейчас придумал…

На таком низком уровне в операционной системе можно где-то еще попытаться променить искусственный интеллект, но каких-то прорывных результатов, я думаю, не стоит ожидать. Но если в одном месте сделать микрооптимизацию, в другом месте микрооптимизацию, то, возможно, суммарный эффект будет весьма неплохим. И это, наверное, было бы неплохой исследовательской такой задачей для студентов.

![]() Андрей Духвалов: То есть искусственный интеллект в качестве… используется для оптимизации планировщика? Да. Почему нет, например? Хорошая тема, мне кажется.

Андрей Духвалов: То есть искусственный интеллект в качестве… используется для оптимизации планировщика? Да. Почему нет, например? Хорошая тема, мне кажется.

![]() Михаил Новоселов: Да. Искусственному интеллекту есть над чем… . Там большой объём данных, собственно, искусственный интеллект смог бы как-то анализировать и потом научить его применять решения. Но здесь нужно будет попытаться весь этот алгоритм настолько оптимизировать, чтобы он работал настолько же быстро, насколько сейчас планировщик, операционная система принимает решение. Не, надо, чтобы быстрее. Если так, как сейчас, так зачем это, тогда, извините, оно уже отлажено. Да, поэтому я и говорю, что здесь каких-то сверхрезультатов не стоит ожидать, но в целом, это вопрос небольшой какой-то языковой модели мощных вычислителей. Это такое, скажем так, маленькая модель, которая должна работать без видеокарты, без множества ядер процессорных и максимально быстро.

Михаил Новоселов: Да. Искусственному интеллекту есть над чем… . Там большой объём данных, собственно, искусственный интеллект смог бы как-то анализировать и потом научить его применять решения. Но здесь нужно будет попытаться весь этот алгоритм настолько оптимизировать, чтобы он работал настолько же быстро, насколько сейчас планировщик, операционная система принимает решение. Не, надо, чтобы быстрее. Если так, как сейчас, так зачем это, тогда, извините, оно уже отлажено. Да, поэтому я и говорю, что здесь каких-то сверхрезультатов не стоит ожидать, но в целом, это вопрос небольшой какой-то языковой модели мощных вычислителей. Это такое, скажем так, маленькая модель, которая должна работать без видеокарты, без множества ядер процессорных и максимально быстро.

![]() Андрей Духвалов: Я бы здесь поспорил. Может быть, здесь нужна большая языковая модель, но не на железке, здесь только inference. А большая языковая модель должна обучаться на каких-то многих… Давайте не будем сейчас спорить. Я имею в виду модель, которая будет принимать решения в режиме реального времени. А обучать, да, это уже, там, другой вопрос, как обучать на основе собранной телеметрии.

Андрей Духвалов: Я бы здесь поспорил. Может быть, здесь нужна большая языковая модель, но не на железке, здесь только inference. А большая языковая модель должна обучаться на каких-то многих… Давайте не будем сейчас спорить. Я имею в виду модель, которая будет принимать решения в режиме реального времени. А обучать, да, это уже, там, другой вопрос, как обучать на основе собранной телеметрии.

![]() Андрей Духвалов: Коллеги, смотрите, я хочу сейчас дать возможность людям задать вопрос. Только, смотрите, буду жёстко, жёстко пресекать. Я вас прошу, потому что у нас ещё второй круг. Я хочу задать экспертам, на мой взгляд, интересный вопрос, и хочу, чтобы у нас было время пообсуждать. Давайте таком, в режиме телеграфном. Короткий вопрос — короткий ответ.

Андрей Духвалов: Коллеги, смотрите, я хочу сейчас дать возможность людям задать вопрос. Только, смотрите, буду жёстко, жёстко пресекать. Я вас прошу, потому что у нас ещё второй круг. Я хочу задать экспертам, на мой взгляд, интересный вопрос, и хочу, чтобы у нас было время пообсуждать. Давайте таком, в режиме телеграфном. Короткий вопрос — короткий ответ.

![]() Александр Певзнер:: Хотел продолжить Мишину мысль. А зачем, там, в реальном времени, чтобы дипсик какой-нибудь шедулил задачи? У нас есть четыре алгоритма шедулинга в Линуксе, да? Ещё, пара десятков экспериментальных алгоритмов. Они, правда, самые оптимальные? Они оптимальны для каких-то условий, но мы не знаем, какой лучше. Пусть нам искусственный интеллект выберет тот алгоритм, который хорош сейчас, а в реальном времени этот алгоритм будет переключать следующие две минуты, а потом искусственный интеллект посмотрит, что получается, и подберет другой.

Александр Певзнер:: Хотел продолжить Мишину мысль. А зачем, там, в реальном времени, чтобы дипсик какой-нибудь шедулил задачи? У нас есть четыре алгоритма шедулинга в Линуксе, да? Ещё, пара десятков экспериментальных алгоритмов. Они, правда, самые оптимальные? Они оптимальны для каких-то условий, но мы не знаем, какой лучше. Пусть нам искусственный интеллект выберет тот алгоритм, который хорош сейчас, а в реальном времени этот алгоритм будет переключать следующие две минуты, а потом искусственный интеллект посмотрит, что получается, и подберет другой.

![]() Андрей Духвалов: И то же самое с пауэр-сейвингом, и то же самое сетями, потому что существует много алгоритмов. То же самое с освобождением памяти, то же самое с виртуальным распределением памяти…

Андрей Духвалов: И то же самое с пауэр-сейвингом, и то же самое сетями, потому что существует много алгоритмов. То же самое с освобождением памяти, то же самое с виртуальным распределением памяти…

![]() Александр Певзнер:: И вот, господа учёные изобретают алгоритмы шедулинга. Господа программисты их реализуют, а искусственный интеллект подбирает под задачу, какой лучше подходит. По-моему, отличная кооперация случилась.

Александр Певзнер:: И вот, господа учёные изобретают алгоритмы шедулинга. Господа программисты их реализуют, а искусственный интеллект подбирает под задачу, какой лучше подходит. По-моему, отличная кооперация случилась.

![]() Андрей Духвалов: Господа учёные разработали эти алгоритмы исходя из условий того времени, старого времени. И там были другие задачи, другое железо и так далее.

Андрей Духвалов: Господа учёные разработали эти алгоритмы исходя из условий того времени, старого времени. И там были другие задачи, другое железо и так далее.

![]() Александр Певзнер:: Я не спорю. Но наука придумала алгоритмы так, чтобы они подходили под большинство задач. А у нас сейчас есть возможность под конкретную задачу выбрать.

Александр Певзнер:: Я не спорю. Но наука придумала алгоритмы так, чтобы они подходили под большинство задач. А у нас сейчас есть возможность под конкретную задачу выбрать.

![]() Артём Проскурнёв: У меня вопрос по поводу взаимодействия самого искусственного интеллекта над системой, мне не очень понятно, с какой целью обсуждались технические детали, как это будет устраиваться. Почему нельзя рассмотреть искусственный интеллект как некая такая вещь, как надсистема, как просто пользователь, работающий за компьютером?

Артём Проскурнёв: У меня вопрос по поводу взаимодействия самого искусственного интеллекта над системой, мне не очень понятно, с какой целью обсуждались технические детали, как это будет устраиваться. Почему нельзя рассмотреть искусственный интеллект как некая такая вещь, как надсистема, как просто пользователь, работающий за компьютером?

![]() Андрей Духвалов: Это кому-то конкретно вопрос, или…

Андрей Духвалов: Это кому-то конкретно вопрос, или…

![]() Артём Проскурнёв: Нет, я вообще… Просто я от нескольких коллег услышал, что, задеваются некие технические моменты, как именно строить и как именно заставить. Почему нельзя? Может быть, кто-то сможет ответить? Или, может быть, можно, вы это не рассматривали?

Артём Проскурнёв: Нет, я вообще… Просто я от нескольких коллег услышал, что, задеваются некие технические моменты, как именно строить и как именно заставить. Почему нельзя? Может быть, кто-то сможет ответить? Или, может быть, можно, вы это не рассматривали?

Использовать искусственный интеллект с операционной системой как пользователя. То есть посадите его, по сути, как пользователя. У него есть глаза, он видит, что на мониторе.

![]() Андрей Духвалов: С какими правами? С админскими?

Андрей Духвалов: С какими правами? С админскими?

![]() Артём Проскурнёв: У нее есть клавиатура, у нее есть мышка. Это раз. Я не услышал, на самом деле, такого важного. Вы не рассматривали вариант…

Артём Проскурнёв: У нее есть клавиатура, у нее есть мышка. Это раз. Я не услышал, на самом деле, такого важного. Вы не рассматривали вариант…

![]() Алексей Хорошилов: А обед 🥗🍜🍝🥂 будет у этого пользователя, предусмотрен, искусственного? 🤔😊

Алексей Хорошилов: А обед 🥗🍜🍝🥂 будет у этого пользователя, предусмотрен, искусственного? 🤔😊

![]() Артём Проскурнёв: Короткий вопрос, собственно. Драйвера для устройств — это самая большая беда, в том числе в Линуксе. Почему искусственный интеллект 🤖 нельзя использовать как драйвер для устройств, которые сам опросит, сам найдёт способ, сам начнёт взаимодействовать с тем устройством, для которого, например, под Linux 🐧 нет драйвера, а только под Windows 🪟 есть.

Артём Проскурнёв: Короткий вопрос, собственно. Драйвера для устройств — это самая большая беда, в том числе в Линуксе. Почему искусственный интеллект 🤖 нельзя использовать как драйвер для устройств, которые сам опросит, сам найдёт способ, сам начнёт взаимодействовать с тем устройством, для которого, например, под Linux 🐧 нет драйвера, а только под Windows 🪟 есть.

![]() Андрей Духвалов: «Большая красная кнопка» 🔴.

Андрей Духвалов: «Большая красная кнопка» 🔴.

![]() Артём Проскурнёв: По сути, да. «Сделать всё хорошо 😌💯😍👌». Коллеги, может, кто-то прокомментировать?

Артём Проскурнёв: По сути, да. «Сделать всё хорошо 😌💯😍👌». Коллеги, может, кто-то прокомментировать?

![]() Павел Мозгов: Давайте я попробую. Про пользователя. По сути, мы говорим про роботизацию 🤖, которая уже существует, на самом деле, когда определенные действия выполняются… Если говорить именно, опять, про пользовательский опыт, да, представьте, если искусственный интеллект перехватит у вас мышку-клавиатуру 🖱⌨🎮 и начнет за все делать. Вы в это время, будете сидеть за этим наблюдать, либо куда-то пойдёте, оставите эту всю историю 🧘💆, вдруг всё получится 🤷. Мне кажется, это такой не очень правильный пользовательский опыт 🤔.

Павел Мозгов: Давайте я попробую. Про пользователя. По сути, мы говорим про роботизацию 🤖, которая уже существует, на самом деле, когда определенные действия выполняются… Если говорить именно, опять, про пользовательский опыт, да, представьте, если искусственный интеллект перехватит у вас мышку-клавиатуру 🖱⌨🎮 и начнет за все делать. Вы в это время, будете сидеть за этим наблюдать, либо куда-то пойдёте, оставите эту всю историю 🧘💆, вдруг всё получится 🤷. Мне кажется, это такой не очень правильный пользовательский опыт 🤔.

Хорошо, когда всё это происходит там где-то, пользователь с этим не соприкасается, он дальше продолжает выполнять свои задачи, а искусственный интеллект помогает ему, какие-то эти задачи автоматизировать.

![]() Иван Татарчук: Меня как представителя Сбертеха очень радует, что упомянули продукт «Gigachat» и его использование в реальной работе. Хотел спросить экспертов, а вот прямо сейчас вы какие нейросети 🦾🧠 используете? Вот действительно интересно. И придём ли мы к тому, что каждая компания будет свою изолируемую разворачивать, чтобы обеспечивать безопасность данных 🤔?

Иван Татарчук: Меня как представителя Сбертеха очень радует, что упомянули продукт «Gigachat» и его использование в реальной работе. Хотел спросить экспертов, а вот прямо сейчас вы какие нейросети 🦾🧠 используете? Вот действительно интересно. И придём ли мы к тому, что каждая компания будет свою изолируемую разворачивать, чтобы обеспечивать безопасность данных 🤔?

![]() Андрей Духвалов: Да, Гигачат неплохо расшифровку аудиозаписей 🎧📝 делает, но там ограничение, по-моему, в 50 мегабайт или в 30. Не любую запись можно в него засунуть. Коллеги, кто хочет ответить? Честно скажите, какую сетку используете?

Андрей Духвалов: Да, Гигачат неплохо расшифровку аудиозаписей 🎧📝 делает, но там ограничение, по-моему, в 50 мегабайт или в 30. Не любую запись можно в него засунуть. Коллеги, кто хочет ответить? Честно скажите, какую сетку используете?

![]() Константин Сорокин: Естественно, для стандартных задач используются классические openapi-шные модели, там, вроде ChatGPT или это Anthropic Plot-овские, если мы говорим про проприетарные модели. Потому что они всё-таки пока относительно непобедимы. Но к вопросу о том, что хочется разворачивать какие-то свои модели, которые в приватном режиме работают, и если есть такие задачи, там, например, по закрытым каким-то проектам, то это всегда открытые модели. И пока что это модели от китайских коллег, Квены последней версии, дипсики, которые с поддержкой резонинга, и дистиллированные версии дипсиков, и, соответственно, какие-то более узкоспециализированные модели, открытые, в зависимости от задачи.

Константин Сорокин: Естественно, для стандартных задач используются классические openapi-шные модели, там, вроде ChatGPT или это Anthropic Plot-овские, если мы говорим про проприетарные модели. Потому что они всё-таки пока относительно непобедимы. Но к вопросу о том, что хочется разворачивать какие-то свои модели, которые в приватном режиме работают, и если есть такие задачи, там, например, по закрытым каким-то проектам, то это всегда открытые модели. И пока что это модели от китайских коллег, Квены последней версии, дипсики, которые с поддержкой резонинга, и дистиллированные версии дипсиков, и, соответственно, какие-то более узкоспециализированные модели, открытые, в зависимости от задачи.

![]() Зритель МЕОБ на OSDAY-2025:: Спасибо за дискуссию. Я слышал, что есть скептики AI, которые говорят, что… вот здесь среди собравшихся, что пока мы не доверяем разработку AI, мы должны его очень хорошо контролировать. В нашей отрасли и за рубежом известны, например, примеры разработки инфраструктурных библиотек 💻📚 с помощью AI 🔮 от и до, где элементами версионного контроля являются промпты. Например, библиотека аутентификации. Известны ли вам какие-то библиотеки, разработанные с помощью AI на более низком уровне, на уровне ОС? Кто-нибудь знает такие проекты 🤔?

Зритель МЕОБ на OSDAY-2025:: Спасибо за дискуссию. Я слышал, что есть скептики AI, которые говорят, что… вот здесь среди собравшихся, что пока мы не доверяем разработку AI, мы должны его очень хорошо контролировать. В нашей отрасли и за рубежом известны, например, примеры разработки инфраструктурных библиотек 💻📚 с помощью AI 🔮 от и до, где элементами версионного контроля являются промпты. Например, библиотека аутентификации. Известны ли вам какие-то библиотеки, разработанные с помощью AI на более низком уровне, на уровне ОС? Кто-нибудь знает такие проекты 🤔?

![]() Андрей Духвалов: Вопрос со звёздочкой ❓🌟🧐.

Андрей Духвалов: Вопрос со звёздочкой ❓🌟🧐.

![]() Стас Фомин: Ну если никто не знает, то вообще-то сейчас народ смотрит код open-source-ный NET-стэка, микрософтовского, и там видно, что он нам написан почти весь AI, и поэтому разработчики бегут из .NET-а. Надеюсь пока, пока не пришел туда нормальный ИИ.

Стас Фомин: Ну если никто не знает, то вообще-то сейчас народ смотрит код open-source-ный NET-стэка, микрософтовского, и там видно, что он нам написан почти весь AI, и поэтому разработчики бегут из .NET-а. Надеюсь пока, пока не пришел туда нормальный ИИ.

![]() Андрей Духвалов: Всё, тогда я к экспертам 🤓🎓 обращусь. А может быть, у вас есть вопросы к аудиторию?

Андрей Духвалов: Всё, тогда я к экспертам 🤓🎓 обращусь. А может быть, у вас есть вопросы к аудиторию?

![]() Константин Сорокин: У меня вопрос. Хочется, чтобы люди подняли руки, кто, в принципе, в повседневной жизни используют АИ как ассистента, какие-нибудь модели (🙌🙌🙌🙌🙌 много рук) И… Так, отлично, вижу.

Константин Сорокин: У меня вопрос. Хочется, чтобы люди подняли руки, кто, в принципе, в повседневной жизни используют АИ как ассистента, какие-нибудь модели (🙌🙌🙌🙌🙌 много рук) И… Так, отлично, вижу.

А теперь второй вопрос. Кто использует неклассический стиль взаимодействия? Грубо говоря, у нас есть стандартная схема с «промотованием», когда вы в режиме чата общаетесь. А кто занимается тем, что пытается как-то правильно подкладывать контекст в разработке? (🙌🙌 3-4 руки)

Я имею в виду, что если вы занимаетесь каким-то большим проектом, то как, на уровне конкретного, файла или модификации понять, что нужно ещё, чтобы было меньше галлюцинаций и так далее? Как расширить правильный контекст? Люди, поднимите руку, кто этим занимается (🙌 две руки). Ага, этих людей сильно меньше. А те, кто поднимал до этого руки, наверное, ну…

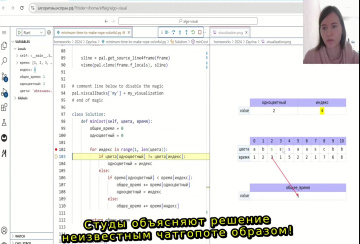

![]() Стас Фомин: Занимается этим прямо сейчас? Прямо сейчас у меня ИИ пишет стенограмму встречи и придумывает вопросы к докладчикам конференции (😂🤣😆 смех в зале, видимо думают что шутка — нет 😁).

Стас Фомин: Занимается этим прямо сейчас? Прямо сейчас у меня ИИ пишет стенограмму встречи и придумывает вопросы к докладчикам конференции (😂🤣😆 смех в зале, видимо думают что шутка — нет 😁).

![]() Константин Сорокин: Если вы не удовлетворены качеством того, как вы сейчас взаимодействуете с моделью, она часто галлюцинирует. Попробуйте правильным образом подкладывать контекст и посмотреть, что сейчас существует, условно говоря, на рынке, или из open-source-инструментов, которые вам помогут в этом.

Константин Сорокин: Если вы не удовлетворены качеством того, как вы сейчас взаимодействуете с моделью, она часто галлюцинирует. Попробуйте правильным образом подкладывать контекст и посмотреть, что сейчас существует, условно говоря, на рынке, или из open-source-инструментов, которые вам помогут в этом.

![]() Николай Костригин: Существует известное выражение «нет никаких облаков, есть чужие компьютеры». Хотелось бы задать аудитории вопрос, все ли осознают, что данные, с которыми вы обращаетесь к нейросети, в основном утекают 🚰📰🌐 куда-то в сеть. А нам обещают, что они приватные, каждому человеку обещают, что его контекст приватный для него 🔏 🤫.

Николай Костригин: Существует известное выражение «нет никаких облаков, есть чужие компьютеры». Хотелось бы задать аудитории вопрос, все ли осознают, что данные, с которыми вы обращаетесь к нейросети, в основном утекают 🚰📰🌐 куда-то в сеть. А нам обещают, что они приватные, каждому человеку обещают, что его контекст приватный для него 🔏 🤫.

![]() Стас Фомин: Нет, никто не обещал ¯\_(ツ)_/¯. Более того, известно, что DeepSeek хранил промпты в открытым Clickhouse с дефолтным пользователем с пустым паролем. И оттуда там за первый год всё слили 🚨😨🚰.

Стас Фомин: Нет, никто не обещал ¯\_(ツ)_/¯. Более того, известно, что DeepSeek хранил промпты в открытым Clickhouse с дефолтным пользователем с пустым паролем. И оттуда там за первый год всё слили 🚨😨🚰.

![]() Андрей Духвалов: Вот еще кейс, по-моему, он 18-го аж года или 19-го. В Самсунге начали применять искусственный интеллект для коммерческих своих задач, повседневных, естественных задач, ещё тогда, ещё, когда мало кто применял. И выяснилось, модель в процессе обучения, та модель, к которой они обращались со своими промпами, в процессе обучения меняла веса таким образом, что кто-то другой мог получить ответ, конфиденциальный, коммерческую тайну. И таким образом, там утекло достаточно большое количество их корпоративных секретов.

Андрей Духвалов: Вот еще кейс, по-моему, он 18-го аж года или 19-го. В Самсунге начали применять искусственный интеллект для коммерческих своих задач, повседневных, естественных задач, ещё тогда, ещё, когда мало кто применял. И выяснилось, модель в процессе обучения, та модель, к которой они обращались со своими промпами, в процессе обучения меняла веса таким образом, что кто-то другой мог получить ответ, конфиденциальный, коммерческую тайну. И таким образом, там утекло достаточно большое количество их корпоративных секретов.

![]() Артём Проскурнёв: Это как раз и беда корпоративной разработки. Поэтому мы и выбираем свободную разработку 🗽🆓🔓📖🤝🐧. Нам скрывать особо нечего.

И когда используем искусственный интеллект, мы используем его в свободной разработке, открытые исходные коды, всё остальное. Для коммерческих организаций, да, это прямо беда, и, наверное, пусть не пользуются. Пусть преимущество будет у тех, кто свободно … 🤘🚀

Артём Проскурнёв: Это как раз и беда корпоративной разработки. Поэтому мы и выбираем свободную разработку 🗽🆓🔓📖🤝🐧. Нам скрывать особо нечего.

И когда используем искусственный интеллект, мы используем его в свободной разработке, открытые исходные коды, всё остальное. Для коммерческих организаций, да, это прямо беда, и, наверное, пусть не пользуются. Пусть преимущество будет у тех, кто свободно … 🤘🚀

![]() Андрей Духвалов: Мы локальные сервера поднимаем под…

Андрей Духвалов: Мы локальные сервера поднимаем под…

![]() Стас Фомин: Угроза опенсорсникам все равно есть. Ты пишешь свой гениальный код, он утекает в сеть и через промты. Там получают код, они его патентуют и всё такое 💡🧾®📝📜👮. И дальше «наезд Оракла»©.

Стас Фомин: Угроза опенсорсникам все равно есть. Ты пишешь свой гениальный код, он утекает в сеть и через промты. Там получают код, они его патентуют и всё такое 💡🧾®📝📜👮. И дальше «наезд Оракла»©.

![]() Андрей Духвалов: Ну, это уже проблема авторских прав. Мы… это, сам… она очень важная, но я боюсь её поднимать. Мы её, это… Не осилим 🪨😩.

Андрей Духвалов: Ну, это уже проблема авторских прав. Мы… это, сам… она очень важная, но я боюсь её поднимать. Мы её, это… Не осилим 🪨😩.

![]() Александр Попов: Ещё один вопрос. Дорогие эксперты, как известно, исследователи безопасности 🥷 находят уязвимость 👾👾 в коде, когда они понимают код лучше, чем его разработчик 🥵. Если у нас весь код, ну или там, подавляющее его количество пишется с помощью ассистентов 🤖🤖, значит, всё меньше людей живых, которые понимают тот или иной код. Поэтому, как вы думаете, вопрос короткий, станет у нас больше уязвимостей 👾👾👾👾 в системном ПО или меньше 👾 с ростом вовлеченности ИИ.

Александр Попов: Ещё один вопрос. Дорогие эксперты, как известно, исследователи безопасности 🥷 находят уязвимость 👾👾 в коде, когда они понимают код лучше, чем его разработчик 🥵. Если у нас весь код, ну или там, подавляющее его количество пишется с помощью ассистентов 🤖🤖, значит, всё меньше людей живых, которые понимают тот или иной код. Поэтому, как вы думаете, вопрос короткий, станет у нас больше уязвимостей 👾👾👾👾 в системном ПО или меньше 👾 с ростом вовлеченности ИИ.

![]() Андрей Духвалов: Экспертная оценка?

Андрей Духвалов: Экспертная оценка?

![]() Михаил Новоселов: Скорее станет больше логических ошибок, потому что очень многие уязвимости 👾👾 — это не из разряда, там, «забыл освободить память» ⚙️🤯📉, а из разряда «просто допустил логическую ошибку».

Михаил Новоселов: Скорее станет больше логических ошибок, потому что очень многие уязвимости 👾👾 — это не из разряда, там, «забыл освободить память» ⚙️🤯📉, а из разряда «просто допустил логическую ошибку».

![]() Александр Попов: Логические ошибки, да, самые вкусные, конечно, но, по-моему, и освобождение памяти тоже остается большой проблемой. Ещё мысли?

Александр Попов: Логические ошибки, да, самые вкусные, конечно, но, по-моему, и освобождение памяти тоже остается большой проблемой. Ещё мысли?

![]() Николай Костригин: Здесь ещё есть проблема того, что при использовании ассистентов в написании кода очень многие однотипные функции могут быть реализованы чуть-чуть по-другому. Происходит дублирование кода. И здесь проблема, серьезная проблема, я думаю.

Кодовая база может содержать реализацию… То, что раньше делалось с библиотеками, которые постепенно, условно, вылизывались, да, из них извлекались баги по чуть-чуть, сейчас, наоборот, идет накопление кода, который реализует одно и то же разными словами.

Николай Костригин: Здесь ещё есть проблема того, что при использовании ассистентов в написании кода очень многие однотипные функции могут быть реализованы чуть-чуть по-другому. Происходит дублирование кода. И здесь проблема, серьезная проблема, я думаю.

Кодовая база может содержать реализацию… То, что раньше делалось с библиотеками, которые постепенно, условно, вылизывались, да, из них извлекались баги по чуть-чуть, сейчас, наоборот, идет накопление кода, который реализует одно и то же разными словами.

![]() Андрей Духвалов: То есть это проблема копипасты в другой реинкарнация, да? Copilot пишет код, запоминает этот результат. Потом другой человек пишет промп, который частично использует этот код. Офигеть!

Андрей Духвалов: То есть это проблема копипасты в другой реинкарнация, да? Copilot пишет код, запоминает этот результат. Потом другой человек пишет промп, который частично использует этот код. Офигеть!